Vapnik-Chervonenkis 차원

Vapnik–Chervonenkis dimensionVapnik-Chervonenkis 이론에서 Vapnik-Chervonenkis(VC) 치수는 통계 이항 분류 알고리즘에 의해 학습될 수 있는 함수 집합의 용량(복잡도, 표현력, 풍부도 또는 유연성)의 척도이다.이는 알고리즘이 파괴할 수 있는 가장 큰 포인트 세트의 카디널리티로 정의됩니다.즉, 알고리즘은 이러한 데이터 포인트의 적어도1개의 설정에 대한 라벨링에 대해 항상 완벽한 분류자를 학습할 수 있습니다.원래 Vapnik과 Alexey Chervonenkis에 [1]의해 정의되었습니다.

비공식적으로, 분류 모델의 용량은 얼마나 복잡할 수 있는가와 관련이 있다.예를 들어, 다항식이 0보다 높게 평가되면 해당 점이 양수로, 그렇지 않으면 음수로 분류되는 고차 다항식의 임계값화를 고려합니다.고차 다항식은 흔들릴 수 있으므로 주어진 훈련 포인트 집합을 잘 맞출 수 있습니다.그러나 분류기가 너무 불안정하기 때문에 다른 부분에서 오류를 범할 것으로 예상할 수 있다.이런 다항식은 용량이 크다.훨씬 더 간단한 대안은 선형 함수를 임계값화하는 것입니다.이 기능은 용량이 낮기 때문에 교육 세트에 잘 맞지 않을 수 있습니다.용량에 대한 이러한 개념은 아래에서 엄격하게 설명됩니다.

정의들

세트 패밀리의 VC 치수

H)를 세트 로 하고 C(\displaystyle C를 세트라고 .이들의 교차는 다음과 같은 집합 패밀리로 정의됩니다.

H \ H \ C C \ C의 서브셋이 포함되어 있는 는 C 의 가H 파괴된다고 합니다.즉, 다음과 같습니다.

H H의 VC D(\ D는 H H에 의해 파괴된 세트 중 가장 큰 카디널리티입니다.임의로 큰 서브셋을 분할할 수 있는 경우 VC 치수는 가 됩니다.

분류 모델의 VC 치수

일부 파라미터 { }를 사용하는 이진 분류 f { f}는 라벨의 모든 할당에 대해 일반적으로 배치된 데이터 포인트1,2, 를 분쇄하는 것으로 알려져 }: 모델 f가 데이터 포인트[citation needed] 세트를 평가할 때 오류가 발생하지 않도록 합니다.

fstyle f의 치수는 f f가 이를 분쇄하도록 배열할 수 있는 최대 포인트 수입니다.좀 더 형식적으로 말하면, 의 일부 데이터 포인트 세트가 f{\f}에 의해 산산조각날 수 있는 D(\ D입니다.

예

1. f는 상수 분류기(파라미터 없음)이다.VC 치수는 0입니다.단일 포인트도 파괴할 수 없기 때문입니다.일반적으로 유한 분류 모델의 VC 치수는 2의 다른 분류자를 반환할 수 있습니다(이것은 VC 치수의 상한이며, Sauer-Shellah lema는 치수의 하한을 나타냅니다).

2. {\ f는 실수의 단일 파라미터 임계값 분류기입니다.즉, 특정 임계값의 f 는 입력번호가 보다 크면 1을 반환합니다. f}의 VC 치수는 1입니다.이는 (a) 1개의 포인트가 깨질 수 있기 때문입니다.모든 x(\ x에 대해 f})는 (\>의 경우 0으로 (\ \theta 의 경우 1로 라벨을 붙입니다. (b) 2개의 점으로 모든 세트를 분쇄할 수 없습니다.두 숫자의 모든 집합에 대해 작은 숫자의 레이블이 1이면 큰 숫자도 레이블이 1이어야 하므로 모든 레이블을 지정할 수 없습니다.

3. { f는 실수의 단일 파라미터 간격 분류자입니다. 특정 의 경우 fis { \ \ }}는 입력번호가[ 、 、、 + + 4에 있는 경우 1을 반환합니다. f}의 VC 치수는 2입니다.이는 (a) 몇 개의 포인트가 깨질 수 있기 때문입니다.만약θ<>만약 θ ∈[)− 4)− 2){\displaystyle \theta \in는 경우에는 x-4,x-2)}로(1,0)예를 들마다 지었지만{x, x+2}{\displaystyle\와 같이{x,x+2\}}, 선별기 f({\displaystyle f_{\theta}}(0,0)으로^− 4{\displaystyle \theta<>x-4}또는θ<>를 사용하여 x+2{\displaystyle \theta>x+2},(1,1)만약 그것이한다. θ ∈[), x] { [ x - 2, x as ( 、 (x , +( x , + 2 (b)3개의 포인트 세트를 부수지 않습니다.세 숫자의 모든 집합에 대해 가장 작은 숫자와 가장 큰 숫자의 레이블이 1이면 가운데 숫자에도 레이블이 1로 지정되어야 하므로 모든 레이블을 지정할 수 없습니다.

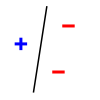

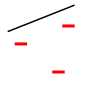

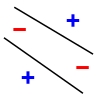

4. f는 2차원 평면에서의 점 분류 모델로서 직선(퍼셉트론이 사용하는 모델)입니다.선은 양의 데이터 점과 음의 데이터 점을 구분해야 합니다.이 모델을 사용하여 실제로 깨질 수 있는 3개의 점 세트가 있습니다(공선적이지 않은 3개의 점은 깨질 수 있습니다).그러나 라돈의 정리에 따르면, 어떤 4개의 점이라도 볼록한 선체가 교차하는 두 개의 부분 집합으로 분할될 수 있으므로, 이 두 부분 집합 중 하나를 다른 부분 집합에서 분리할 수 없다.따라서 이 특정 분류자의 VC 치수는 3입니다.포인트 배열을 선택할 수 있지만 라벨 할당을 위해 분할하려고 할 때 포인트 배열을 변경할 수 없다는 점을 기억해야 합니다.3개의 점에는 2 = 8개의3 가능한 레이블 할당 중 3개만 표시됩니다.

|  |  |  |

| 3점 산산조각 | 4점 불가 | ||

5. {\f}는 단일 사인 분류기입니다.즉, 특정 파라미터 {\ \의 경우 f {\f_{\ 는 x {\ x에 sin {\ x이 1을 반환합니다.f{\ f의 VC 치수는 무한합니다.{ \ { m \ m \ \ {[2]: 57 display { { { of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of of

사용하다

통계학습이론에서

VC 치수는 분류 모델의 테스트 오류에 대한 확률적 상한을 예측할 수 있다.Vapnik은[3] (훈련 세트와 동일한 분포에서 도출된 데이터에 대한) 상한으로부터 거리를 둔 테스트 오류(0-1 손실 함수의 위험)의 확률이 다음과 같이 제공된다는 것을 증명했다.

분류 모델의 D는 어디{D\displaystyle}은 VC치수, 0<>η ⩽ 1{0<, \eta \leqslant 1\displaystyle}, 그리고 훈련 세트(제한의 N{N\displaystyle}크기:D≪ N{D\ll N\displaystyle}이 공식 유효합니다. D의{D\displaystyle} 크면 test-error b. 수 있e훨씬훈련 오류보다 더 높아요.이는 과적합에 의한 것입니다).

VC 치수는 샘플 복잡도 경계에도 표시됩니다.VC D(\ D의 이진 함수 공간은 다음을 사용하여 학습할 수 있습니다.

샘플. 서 은 학습 오류이고 "는 실패 확률입니다따라서 표본 복잡도는 가설 공간의 VC 차원에 대한 선형 함수입니다.

계산기하학에서

VC 치수는 "nets" 크기의 중요한 파라미터 중 하나이며, 이를 기반으로 근사 알고리즘의 복잡성을 결정합니다.유한 VC 치수가 없는 범위 세트에는 유한한 "net"이 전혀 없습니다.

경계

0. F의 듀얼 세트 패밀리의 VC 치수는 2 µ ( + 2mathcal {보다 작으며, 이것이 최선이다.

1. 유한 집합 H H의 VC 치수는 최대 22(\ _[2]: 56 입니다.이것은 정의상 H H C H이기 입니다.

2. 세트 H(\ H를 지정하면 H 요소의 모든 을 포함하는 세트 패밀리로 H(\H를 합니다.[2]: 57 다음:

3. 세트 H(\ H와 H가 주어지면 H 를 합니다그 [2]: 58 후, 다음과 같이 입력합니다.

유한 투영 평면의 VC 치수

순서 n의 유한 투영 평면은 n + n + 1 요소 ("점"이라고 함)에 대한 n + n + 1 세트 ("선")의2 집합이다2.

- 각 행에는 정확히 n + 1개의 점이 포함됩니다.

- 각 선은 정확히 한 점에서 다른 모든 선과 교차합니다.

- 각 점은 정확히 n + 1 행에 포함됩니다.

- 각 점은 다른 점들과 정확히 한 줄에 공통으로 있습니다.

- 최소 4개의 점이 공통 선에 있지 않습니다.

유한 투영 평면의 VC 치수는 [4]2입니다.

증명: (a) 각각의 구별되는 점에 대해, (a) 둘 다 포함된 한 줄, 둘 중 하나만 포함된 선, 둘 다 포함되지 않은 선이 있기 때문에 크기 2의 모든 세트는 산산조각이 납니다. (b) 구별되는 3개의 점 중 어느 하나에 대해 x가 3개를 모두 포함하는 경우, 정확히 두 개의 선을 포함하는 y는 존재하지 않습니다(t 이후).hen x와 y는 투영 평면의 정의에 반하는 두 점에서 교차한다.)따라서 사이즈 3의 세트는 깨지지 않는다.

부스팅 분류자의 VC 차원

VC 치수가 D(\ D인 단순 분류자의 기본 B(\ B가 있다고 가정합니다.

B B의 여러 분류기를 조합하여 보다 강력한 분류기를 구축할 수 있습니다.이 기법을 부스팅이라고 합니다.공식적으로T {\ T h, B {\ B 및 무게 w T{\ w를 하면 다음 분류자를 정의할 수 있습니다.

이러한 모든 분류자 세트의 VC 치수(B에서 T 분류자 및 T에서 Weight-Vector를 한 경우)는 T 3[5]: 108–109 T, 3의 최대값입니다.

뉴럴 네트워크의 VC 차원

이 섹션은 확인을 위해 추가 인용문이 필요합니다.(2021년 (템플릿메시지 및 에 대해 ) |

뉴럴 네트워크는 유도 비순환 그래프 G(V,E)로 설명되며, 여기서 다음과 같다.

- V는 노드 집합입니다.각 노드는 단순한 계산 셀입니다.

- E는 에지 세트이며, 각 에지에는 무게가 있습니다.

- 네트워크에 대한 입력은 들어오는 가장자리가 없는 노드인 그래프의 소스로 표시됩니다.

- 네트워크의 출력은 그래프의 싱크(발신 에지가 없는 노드)로 표시됩니다.

- 각 중간 노드는 들어오는 에지에서 노드 출력의 가중치 합계를 입력으로 얻습니다.여기서 가중치는 에지의 가중치입니다.

- 각 중간 노드는 부호함수 또는 시그모이드함수와 같은 입력의 특정 증가함수를 출력한다.이 기능을 활성화 기능이라고 합니다.

뉴럴 네트워크의 VC 치수는 다음과 [5]: 234–235 같이 제한됩니다.

- 액티베이션 함수가 부호 함수이고 무게가 일반인 경우 VC 치수는 O '' () \ O \() )。

- 액티베이션 함수가 Sigmoid 함수이고 무게가 일반인 경우 VC 치수는 최소 (2 (^{이고 O ( 2 2 O V 입니다.

- 무게가 유한 패밀리에서 나오는 경우(예를 들어, 무게는 컴퓨터에서 최대 32비트로 나타낼 수 있는 실수) 두 활성화 기능 모두에서 VC 치수는 O O입니다

일반화

VC 차원은 이진 함수 공간({0,1}에 대한 함수)에 대해 정의됩니다.비이항 함수의 공간에 대해 몇 가지 일반화가 제안되었다.

- 다중 클래스 함수(예: {0,...n-1}에 대한 함수)의 경우 Natarajan[6] 치수를 사용할 수 있습니다.Ben David 등은[7] 이 개념의 일반화를 제시한다.

- 실제값 함수(예를 들어 실제 간격에 대한 함수 [0,1])에 대해서는 폴라드의 의사[8][9][10] 차원을 사용할 수 있다.

- Rademacher의 복잡성은 VC와 유사한 경계를 제공하며 커널을 사용하는[citation needed] 방법 등의 통계 방법에 대한 VC 차원 계산보다 더 많은 통찰력을 제공할 수 있습니다.

- 메모리 용량(메모리 등가 용량)은 상한(예:인위적인_neural_network#Capacity)로 인해 과적합 가능성이 있는 포인트를 나타냅니다.

「 」를 참조해 주세요.

- 성장 함수

- Sauer-Shellah lema. VC 치수에 관한 세트시스템 내 세트 수에 대한 제한입니다.

- 카르핀스키-매킨타이어 정리,[11] 일반적인 파피아 공식의 VC 차원에 대한 경계.

각주

- ^ Vapnik, V. N.; Chervonenkis, A. Ya. (1971). "On the Uniform Convergence of Relative Frequencies of Events to Their Probabilities". Theory of Probability & Its Applications. 16 (2): 264. doi:10.1137/1116025. 이것은 B의 영어 번역본입니다.러시아 신문의 Seckler:"균일 컨버전스 상대 Frequencies의 사건들의 그들의 Probabilities에".Dokl.Akad.Nauk.181(4):781.1968년.그 번역 Vapnik, VN;Chervonenkis, A. 응.(2015년):복제 했다."균일 컨버전스 상대 Frequencies의 사건들의 그들의 Probabilities에".복잡함의 조치. p. 11.doi:10.1007/978-3-319-21852-6_3.아이 에스비엔 978-3-319-21851-9.

- ^ a b c d Mohri, Mehryar; Rostamizadeh, Afshin; Talwalkar, Ameet (2012). Foundations of Machine Learning. USA, Massachusetts: MIT Press. ISBN 9780262018258.

- ^ Vapnik 2000.

- ^ Alon, N.; Haussler, D.; Welzl, E. (1987). "Partitioning and geometric embedding of range spaces of finite Vapnik-Chervonenkis dimension". Proceedings of the third annual symposium on Computational geometry – SCG '87. p. 331. doi:10.1145/41958.41994. ISBN 978-0897912310. S2CID 7394360.

- ^ a b Shalev-Shwartz, Shai; Ben-David, Shai (2014). Understanding Machine Learning – from Theory to Algorithms. Cambridge University Press. ISBN 9781107057135.

- ^ 나타라얀 1989년

- ^ 벤 데이비드, 세자비안치 & 롱 1992.

- ^ 폴라드 1984년

- ^ Anthony & Bartlett 2009.

- ^ Morgenstern & Roughgarden 2015.

- ^ Karpinski & Macintyre 1997.

레퍼런스

- Moore, Andrew. "VC dimension tutorial".

- Vapnik, Vladimir (2000). The nature of statistical learning theory. Springer.

- Blumer, A.; Ehrenfeucht, A.; Haussler, D.; Warmuth, M. K. (1989). "Learnability and the Vapnik–Chervonenkis dimension" (PDF). Journal of the ACM. 36 (4): 929–865. doi:10.1145/76359.76371. S2CID 1138467.

- Burges, Christopher. "Tutorial on SVMs for Pattern Recognition" (PDF). (VC 차원 정보도 포함)

- Chazelle, Bernard. "The Discrepancy Method".

- Natarajan, B.K. (1989). "On Learning sets and functions". Machine Learning. 4: 67–97. doi:10.1007/BF00114804.

- Ben-David, Shai; Cesa-Bianchi, Nicolò; Long, Philip M. (1992). "Characterizations of learnability for classes of {O, …, n}-valued functions". Proceedings of the fifth annual workshop on Computational learning theory – COLT '92. p. 333. doi:10.1145/130385.130423. ISBN 089791497X.

- Pollard, D. (1984). Convergence of Stochastic Processes. Springer. ISBN 9781461252542.

- Anthony, Martin; Bartlett, Peter L. (2009). Neural Network Learning: Theoretical Foundations. ISBN 9780521118620.

- Morgenstern, Jamie H.; Roughgarden, Tim (2015). On the Pseudo-Dimension of Nearly Optimal Auctions. NIPS. arXiv:1506.03684. Bibcode:2015arXiv150603684M.

- Karpinski, Marek; Macintyre, Angus (February 1997). "Polynomial Bounds for VC Dimension of Sigmoidal and General Pfaffian Neural Networks". Journal of Computer and System Sciences. 54 (1): 169–176. doi:10.1006/jcss.1997.1477.

H

H

라벨의 모든 할당에 대해 일반적으로

라벨의 모든 할당에 대해 일반적으로

다른 분류자를 반환할 수 있습니다(이것은 VC 치수의 상한이며,

다른 분류자를 반환할 수 있습니다(이것은 VC 치수의 상한이며,  입력번호가

입력번호가

경우 0으로

경우 0으로

![{\displaystyle [\theta ,\theta +4]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a8d44ec88941a2c7c909ec726a88aa5002d3990d) 있는 경우 1을 반환합니다.

있는 경우 1을 반환합니다.![{\displaystyle \theta \in [x-2,x]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3cc0c0ffdae78696f1de7a552a80d2cc59e18694)

![{\displaystyle \theta \in (x,x+2]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b4adcdf37171b523669f5352c245d8de775ab92f)

![{\displaystyle \Pr \left({\text{test error}}\leqslant {\text{training error}}+{\sqrt {{\frac {1}{N}}\left[D\left(\log \left({\tfrac {2N}{D}}\right)+1\right)-\log \left({\tfrac {\eta }{4}}\right)\right]}}\,\right)=1-\eta ,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/518a774d3b4aa1def505fa59f64331c79ef6b825)

학습 오류이고

학습 오류이고

듀얼 세트 패밀리의 VC 치수는 2

듀얼 세트 패밀리의 VC 치수는 2

있다고 가정합니다.

있다고 가정합니다.