모델레이트 시스템

Moderation system

사용자에게 댓글을 달도록 요청하는 인터넷 웹사이트에서, 모델레이션 시스템은 웹 마스터가 유용하거나 유익한 게시물에 대해 관련이 없거나, 외설적이거나, 불법적이거나, 유해하거나, 모욕적인 게시물을 분류하기 위해 선택하는 방법입니다.콘텐츠 모델레이션의 목적은 문제가 있는 콘텐츠에 경고 라벨을 제거 또는 적용하거나 사용자가 [1]직접 콘텐츠를 차단 및 필터링할 수 있도록 하는 것입니다.

인터넷 포럼, 블로그, PHPBB, Wiki 또는 PHP-Nuke와 같은 스크립트로 제공되는 뉴스 사이트 등 다양한 유형의 인터넷 사이트에서 사용자 생성 컨텐츠가 허용됩니다.사이트의 내용 및 대상 사용자에 따라 웹 마스터는 적절한 사용자 코멘트의 종류를 결정한 후 코멘트를 선별하는 책임을 덜 진행자에게 위임합니다.대부분의 경우 웹 마스터는 트롤링, 스팸 발송 또는 플래밍을 제거하려고 시도하지만 이는 사이트마다 크게 다릅니다.

주요 플랫폼에서는 알고리즘 도구, 사용자 보고 및 인적 [1]검토의 조합을 사용합니다.소셜 미디어 사이트에서는 콘텐츠 모델레이터를 고용하여 헤이트 스피치 또는 기타 유해한 콘텐츠에 대해 플래그가 부착된 콘텐츠를 수동으로 검사하거나 삭제할 수도 있습니다.다른 콘텐츠 문제에는 리벤지 포르노, 그래픽 콘텐츠, 아동 학대 및 [1]선전이 포함됩니다.또한 일부 웹사이트는 콘텐츠를 광고에 [1]적합하게 만들어야 합니다.

슈퍼바이저 모델레이트

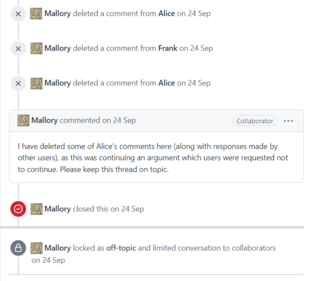

일방적 절제라고도 알려진 이러한 종류의 절제 시스템은 인터넷 포럼에서 자주 볼 수 있다.사용자 그룹은 웹마스터에 의해 (일반적으로 장기간에 걸쳐) 위임자로 선택되며 웹마스터를 대신하여 커뮤니티 규칙을 적용합니다.이러한 진행자는 다른 사람의 투고를 삭제 또는 편집하거나 자신의 이메일 주소 또는 IP 주소에 따라 사용자를 제외할 수 있는 특권을 부여받으며 일반적으로 커뮤니티 전체에서 부정적인 투고를 제거하려고 시도합니다.이들은 보이지 않는 중추 역할을 하며 소셜 웹을 중요하지만 저평가된 [2]역할로 뒷받침합니다.

페이스북의 경우 법적 논란 등으로 콘텐츠 진행자를 4500명에서 2017년 7500명으로 늘렸다.독일에서 페이스북은 헤이트 스피치가 [3]게시된 후 24시간 이내에 삭제될 책임이 있다.2015년 8월부터 2017년 12월까지 트위터는 IS와 [4]관련된 콘텐츠의 수와 양을 줄이기 위해 120만 개 이상의 테러리스트 콘텐츠 계정을 정지시켰다.

CCM(Commercial Content Moderation)

Commercial Content Moderation은 Sarah T. Roberts에 의해 만들어진 용어입니다.이 용어는 콘텐츠가 법적 및 규제상의 긴급상황, 사이트/커뮤니티 가이드라인, 사용자 동의에 준거하고 규범에 부합하는 것을 보증하기 위해 모든 유형의 소셜 미디어 플랫폼에 대해 UGC(사용자 생성 콘텐츠)를 감시 및 검증하는 관행을 나타내기 위해 사용됩니다.그 사이트와 그 문화적 [5]맥락에 대한 취향과 수용성.

한때 이 작업은 온라인 커뮤니티 내의 자원 봉사자에 의해 이루어졌을 수 있지만, 상업용 웹사이트의 경우 주로 인도나 필리핀과 같은 저임금 지역에 있는 전문 회사에 아웃소싱함으로써 달성된다.소셜 미디어 붐의 결과로 콘텐츠 모델레이션 직종의 아웃소싱이 성장했습니다.사용자와 UGC가 압도적으로 증가함에 따라 기업은 콘텐츠를 관리하기 위해 더 많은 직원을 필요로 했습니다.1980년대 후반과 1990년대 초반, 기술 회사들은 교육받은 노동력을 가지고 있지만 [6]싼 값에 일하고자 하는 외국으로 일자리를 아웃소싱하기 시작했다.

직원들은 불쾌한 내용을 보고, 평가하고, 삭제함으로써 일을 하며,[7][8][9][10][2][11] 정신적 피해를 입을 수 있습니다.PTSD와 유사한 증상과 [12]함께 2차 외상이 발생할 수 있습니다.페이스북과 같은 일부 대기업들은 심리적인[12] 지원을 제공하며 인공지능(AI)을 이용해 가장 생생하고 부적절한 콘텐츠를 선별하는 데 점점 더 의존하고 있지만,[13][14] 이를로는 불충분하다고 비판하고 있다.

페이스북

Facebook은 어떤 콘텐츠가 남아 있고 어떤 콘텐츠가 제거되는지를 결정하는 감독위원회를 만들기로 결정했다.이 아이디어는 2018년 말에 제안되었다.페이스북의 '최고법원'은 결정을 [14]임시변통으로 대체하는 것이다.

분산 모델레이트

분산 모델레이션에는 사용자 모델레이션과 자발 모델레이션의 두 가지 유형이 있습니다.

사용자 모델레이트

사용자 모델레이터를 사용하면 모든 사용자가 다른 사용자의 기여를 모델레이터할 수 있습니다.현재 수십억 명의 사람들이 매일 [15]무엇을 공유, 전달 또는 가시성 제공할지 결정하고 있습니다.활동 인구가 충분히 많은 큰 사이트에서는, 비교적 적은 수의 문제아들이 커뮤니티의 다른 사람들의 투표에 의해 배제되기 때문에, 이것은 보통 잘 작동한다.엄밀히 말하면 Wikipedia와 같은 Wikipedia는 [citation needed]궁극적인 사용자 모델레이션이지만, 인터넷 포럼의 맥락에서 사용자 모델레이션 시스템의 최종적인 예는 Slashdot입니다.

예를 들어, 각 진행자에게는 제한된 수의 "mod point"가 주어지며, 각각을 사용하여 개개의 코멘트를 1포인트씩 올리거나 내릴 수 있습니다.따라서 코멘트는 점수를 누적하여 -1 ~ 5점 범위로 추가로 제한됩니다.사이트를 표시할 때 동일한 척도에서 임계값을 선택할 수 있으며, 해당 임계값을 충족하거나 초과한 게시물만 표시됩니다.이 시스템은 카르마 개념에 의해 더욱 개선됩니다.사용자의 이전 기여에 할당된 등급은 사용자가 수행한 기여의 초기 등급을 편향시킬 수 있습니다.

충분히 전문화된 웹사이트에서 사용자 중재는 종종 그룹사고로 이어집니다.이 경우 웹사이트의 확립된 원칙과 일치하지 않는 의견은 (아무리 건전하거나 잘 표현되어 있더라도) "축소"되고 검열되어 그룹사고 사고 사고방식의 영속화로 이어집니다.이것은 종종 [citation needed]트롤링과 혼동됩니다.

사용자 모델레이션은 반응 모델레이션으로도 특징지을 수 있습니다.이러한 유형의 조정은 부적절하고 커뮤니티 표준을 위반하는 콘텐츠를 보고하는 플랫폼 또는 사이트 사용자에 따라 달라집니다.이 과정에서 사용자가 부적합하다고 판단되는 이미지 또는 비디오에 직면하면 Report 버튼을 클릭할 수 있습니다.제소는 접수되고 진행자가 [16]볼 수 있도록 대기 중이다.

자발적 절제

자발적 절제는 공식적인 절제가 존재하지 않을 때 일어난다.코멘트를 관리할 수 없는 경우, 유저는 타인의 코멘트에 대해서 자신의 코멘트를 투고하는 것에 의해서, 자발적으로 동료의 코멘트를 조정할 수 있습니다.자발적 절제가 존재하기 때문에 사용자가 자신의 콘텐츠를 제출하도록 허용하는 시스템은 어떠한 [citation needed]절제도 없이 완전히 진행될 수 없습니다.

「 」를 참조해 주세요.

레퍼런스

- ^ a b c d Grygiel, Jennifer; Brown, Nina (June 2019). "Are social media companies motivated to be good corporate citizens? Examination of the connection between corporate social responsibility and social media safety". Telecommunications Policy. 43 (5): 2, 3. doi:10.1016/j.telpol.2018.12.003. Retrieved 25 May 2022.

- ^ a b "Invisible Data Janitors Mop Up Top Websites - Al Jazeera America". aljazeera.com.

- ^ "Artificial intelligence will create new kinds of work". The Economist. Retrieved 2017-09-02.

- ^ Gartenstein-Ross, Daveed; Koduvayur, Varsha (26 May 2022). "Texas's New Social Media Law Will Create a Haven for Global Extremists". foreignpolicy.com. Foreign Policy. Retrieved 27 May 2022.

- ^ "Behind the Screen: Commercial Content Moderation (CCM)". Sarah T. Roberts The Illusion of Volition. 2012-06-20. Retrieved 2017-02-03.

- ^ Elliott, Vittoria; Parmar, Tekendra. ""The darkness and despair of people will get to you"". rest of world.

{{cite web}}: CS1 maint :url-status (링크) - ^ Stone, Brad (July 18, 2010). "Concern for Those Who Screen the Web for Barbarity" – via NYTimes.com.

- ^ Adrian Chen (23 October 2014). "The Laborers Who Keep Dick Pics and Beheadings Out of Your Facebook Feed". WIRED. Archived from the original on 2015-09-13.

- ^ "The Internet's Invisible Sin-Eaters". The Awl. Archived from the original on 2015-09-08.

- ^ University, Department of Communications and Public Affairs, Western (March 19, 2014). "Western News - Professor uncovers the Internet's hidden labour force". Western News.

- ^ "Should Facebook Block Offensive Videos Before They Post?". WIRED. 26 August 2015.

- ^ a b Olivia Solon (2017-05-04). "Facebook is hiring moderators. But is the job too gruesome to handle?". The Guardian. Retrieved 2018-09-13.

- ^ Olivia Solon (2017-05-25). "Underpaid and overburdened: the life of a Facebook moderator". The Guardian. Retrieved 2018-09-13.

- ^ a b Gross, Terry. "For Facebook Content Moderators, Traumatizing Material Is A Job Hazard". NPR.org.

- ^ Hartmann, Ivar A. (April 2020). "A new framework for online content moderation". Computer Law & Security Review. 36: 3. doi:10.1016/j.clsr.2019.105376. Retrieved 25 May 2022.

- ^ Graimes-Viort, Blaise (2010년 12월 7일)"알아야 할 6가지 콘텐츠 모델레이션"오늘의 소셜 미디어

외부 링크

- Slashdot – 사용자 모델레이션의 결정적인 예

- 콘텐츠 모델레이션의 기본

- Cliff Lampe and Paul Resnick : 슬래시(점)와 번: 대규모 온라인 대화 공간에서 분산 모델레이트 컴퓨팅 시스템 목차에 관한 SIGCHI 회의 진행, Vienna, 2005, 543-550.

- Hamed Alhoori, Omar Alvarez, Richard Furuta, Miguel Muniz, Eduard Urbina:온라인 평판 기반의 소셜 콜라보레이션을 통해 커뮤니티에 의한 학술적 참고문헌 작성 지원ECDL 2009: 180 ~191