다변량 정규 분포

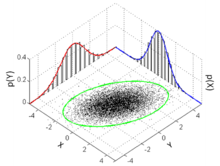

Multivariate normal distribution| 확률밀도함수  μ와 다변량 정규 분포에서 많은 샘플 포인트)[00]}=\left[{\begin{}smallmatrix 0\\0\end{smallmatrix}}\right]}과Σ)[13/53/52]}{\displaystyle{\boldsymbol{\Sigma}=\left는 경우에는{\begin{smallmatrix}1&, 3/5\\3/5&, 2\end{ 작은{\displaystyle{\boldsymbol{\mu}.매트릭스}} 3각 타원, 2개의 한계 분포 및 2개의 1-d 히스토그램과 함께 표시됩니다. | |||

| 표기법 | |||

|---|---|---|---|

| 파라미터 | μ µk R :장소 δk × k δ R - 공분산(양반정의 행렬) | ||

| 지지하다 | x μ + span(δ) rk R | ||

| δ가 정의 정의일 때만 존재합니다. | |||

| 의미하다 | μ | ||

| 모드 | μ | ||

| 분산 | Σ | ||

| 엔트로피 | |||

| MGF | |||

| CF | |||

| 쿨백-라이블러 발산 | 이하를 참조해 주세요 | ||

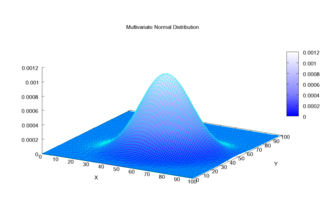

확률론과 통계학에서 다변량 정규분포, 다변량 가우스 분포 또는 합동 정규분포는 1차원 정규분포를 더 높은 차원으로 일반화한 것이다.한 가지 정의는 k 성분의 모든 선형 조합이 일변량 정규 분포를 갖는 경우 랜덤 벡터가 k-변수 정규 분포라고 하는 것입니다.그 중요성은 주로 다변량 중심 한계 정리에서 비롯된다.다변량 정규 분포는 각각이 평균 값 주위에 군집화되어 있는 (가능성이 있는) 상관된 실제 값 랜덤 변수 집합을 설명하는 데 자주 사용됩니다.

정의들

표기법 및 파라미터화

k차원 랜덤 X ( 1,… , X ) {\ =(의 다변량 정규 분포는 다음과 같은 표기법으로 쓸 수 있다.

또는 X가 k차원임을 명확히 알리기 위해

k차원 평균 벡터를 사용하여

k × { k k 공분산 행렬

1 i {{ ik.} 공분산 행렬의 역행렬을 행렬이라고 하며, {\displaystyle Q} = boldsymbol Q} 로 나타낸다.

표준 정규 랜덤 벡터

실제 랜덤 X ( , , k ) =(}}}는 성분 k {\k}}가 모두 독립적이고 각 단위가 0일 때 표준 정규 랜덤 벡터라고 불린다. ( ,) \ X _ { } \\ \ { } ( , [1]: p. 454 。

중심 정규 랜덤 벡터

실제 랜덤 X ( , , ) =(는 k ×\ k\times\ 이 존재하는 경우 중심 정규 랜덤 벡터라고 합니다은 X{\ 와 분포를 가집니다.서 Z \Z 는 {\[1]: p. 454 {\ 성분의 표준 정규 랜덤 벡터입니다.

정규 랜덤 벡터

실수 랜덤 X ( , , ) =(}}}는 랜덤 {\\ell - Z {} } a there a \ \ \ \ \ \ \ \mathbf} } a} a} a} a \ a}}}}} \ \} \mathbf {{{{{{{{{(\ 및 ×(\ k A A {A})

형식:

여기서 공분산 행렬은 {\ {\}}= {\ {\ 입니다.

공분산 행렬이 특이할 경우 해당 분포에는 밀도가 없습니다. 자세한 내용은 아래 절을 참조하십시오.이 경우는 통계량, 예를 들어 정규 최소 제곱법에서 잔차 벡터의 분포에서 자주 발생합니다.})는 일반적으로 독립적이지 않습니다 독립가우스 Z(\displaystyle 컬렉션에 A(\displaystyle를 적용한 결과라고 볼 수 있습니다.

동등한 정의

다음 정의는 위에 제시된 정의와 동일합니다.랜덤 X ( , , k ) {\ =( 다음 동등한 조건 중 하나를 만족하는 다변량 정규 분포를 가집니다.

- 각 성분들의 조합 X 1 + + k {\ Y}X_{k}X_는 정규 분포를 따릅니다.즉, 임의의 상수 a R \ \ \^{\= X Y=\ {} \ }에 대해 랜덤 Y 는 정규 분포를 가진다.

- 와 대칭 의k ×(\k\k 행렬(\ 가 있으며 의 함수는 과 같다.

구면 정규 분포는 성분이 직교 [3][4]좌표계에서 독립적인 고유한 분포로 특징지을 수 있습니다.

밀도 함수

비퇴행성 케이스

다변량 정규 분포는 대칭 공분산 행렬 style가 양수이면 "비퇴화"라고 한다.이 경우 분포는 밀도가[5] 있습니다.

서 x는 실제 k차원 열 벡터이고 는 det의 결정 변수입니다.위의 방정식은(\가 1×(\ 11) (즉, 단일 실수)인 경우 일변량 정규 분포로 감소합니다.

복잡한 정규 분포의 원형 대칭 버전은 약간 다른 형태를 가집니다.

각 Iso-density 궤적(각각 밀도의 특정 값을 제공하는 k차원 공간 내 점의 궤적)은 타원 또는 그 고차원 일반화이다. 따라서 다변량 정규 분포는 타원 분포의 특수한 경우이다.

( - ) - (x - { { ( \ } } - { \ {t} }{ \ { } } { \ } } - } { \ {\일 때 분포는 일변량 정규 분포로 감소하고 마할라노비스 거리는 표준 점수의 절대값으로 감소합니다.아래의 간격도 참조하십시오.

이변량 케이스

2차원 비싱글 케이스( ( ) \ k = \} \ ( \ \ right ) )에서 벡터 [ \ style \ text {}의 확률 밀도 함수 ]}} } } :

서 { }는와 의이며 X> 0 \ \_ { } > 0 및 Y \ \_ { }> 입니다.이 경우,

이변량의 경우, [의 벡터가 이라고 결론짓기 위해 X X와 Y(\ Y의 여러 개별 선형 조합이 정상임을 확인하기에 충분하기 때문에 다변량 정규성 재구성을 위한 첫 번째 등가 조건을 덜 제한적으로 만들 수 있다.은(는) [6]이변량 정규입니다.

x, , y , \ , y - 평면에 표시된 이변량 iso-density loci는 타원형이며, 주축은 공분산 행렬 \ \ \ \ Sigma (타원의 주 및 부 반변량 반변수들은 순서 고유값의 제곱근과 동일)의 고유 벡터에 의해 정의된다.

상관 파라미터δ(\의 절대값이 증가함에 따라 이들 로키는 다음 행으로 압축됩니다.

는 ( sgn은 부호함수)이 로 대체된 이 표현식이 X X[7]의 이 주어진 Y Y의 의 선형 불편 예측이기 때문입니다.

퇴화 케이스

공분산 행렬(\가 풀 랭크가 아닌 경우 다변량 정규 분포는 퇴화되어 밀도가 없습니다.더 정확히는 k차원 르베게 측정(미적분 수준 확률 코스에서 가정하는 일반적인 측정)에 대한 밀도가 없습니다.측정치와 관련하여 분포가 절대적으로 연속적인 랜덤 벡터만 밀도가 있다고 한다.밀도에 대해 설명하되 측정이론적인 복잡성을 다루지 않으려면x 의 부분 집합 ( ) \ {rank } ( \ \ )로 주의를 제한하여 이 부분 집합의 공분산 행렬이 양의 행렬이 되도록 하는 것이 더 간단할 수 있다.다른 좌표는 선택된 좌표의 [8]아핀 함수로 간주할 수 있다.

단일한 경우에 밀도에 대해 의미 있게 이야기하려면 다른 기본 척도를 선택해야 합니다.분해정리를 사용하여 가우스 분포가 지원되는 의 ({displaystyle \ {Rk -차원 아핀 부분 공간 displaystyle} ^{k}){ +까지 르베그 측정의 제한을 정의할 수 있다 k { \ { \ \ { \ ^ { / } } \ } : \ { } { k } \ } 。이 측정에 대한 분포의 밀도는 다음과 같습니다.

서δ+({{{는 일반화 역,k({k는({ {의 , t det는 의사 결정자입니다.[9]

누적분포함수

차원 1의 누적분포함수(cdf)의 개념은 직사각형 및 타원형 영역에 기초한 다차원 사례로 두 가지 방법으로 확장될 수 있다.

첫 번째 방법은 랜덤 X(\displaystyle [10]의 F { F를 X의 모든 성분이 벡터x(\ {의 대응하는 값 이하일 확률로 정의하는 것입니다.

F( ) \ F ( \ 에는 닫힌 형식이 없지만 수치로 [10][11]추정하는 알고리즘이 많이 있습니다.

또 다른 방법은 F { F를 표준편차의 [12]직접적인 일반화인 가우스로부터의 마할라노비스 r(\r)에 의해 결정된 타원체 내부에 샘플이 존재할 확률로 정의하는 것입니다.이 함수의 값을 계산하기 위해 다음과 같은 닫힌 해석식이 존재한다.[12]

간격

다변량 정규 분포의 구간은 다음을 만족하는 벡터 x로 구성된 영역을 산출합니다.

서 x는 kk) 차원 벡터, 는 k 차원 평균 벡터,\sigmbol\sigmbol\ 는 알려진 공분산 행렬입니다.{은 k[13] k를 갖는 카이스트 분포의 p p에 대한 분위수 함수입니다 때 k 식은 타원의 내부를 정의하고 카이스트 분포는 평균이 2인 지수 분포로 단순화됩니다(속도는 절반).

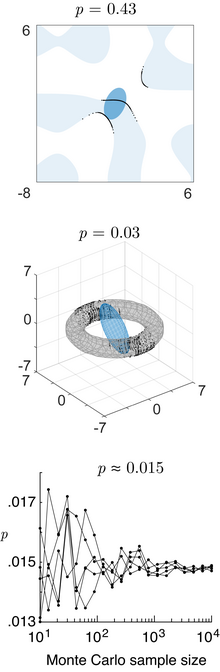

상보 누적 분포 함수(꼬리 분포)

상보적 누적분포함수(ccdf) 꼬리분포는 ( ) - ( Xx) \ ( \ { } ) 1 - \ {( \ X )로 됩니다{\ ccdf는 종속 가우스 변수의 [14]최대값 확률로 기술할 수 있습니다

ccdf 계산을 위한 간단한 닫힌 공식은 존재하지 않지만, 몬테 카를로 [14][15]방법을 통해 의존적인 가우스 변수의 최대값을 정확하게 추정할 수 있다.

특성.

다른 도메인에서의 확률

x+q0을은 다변량 정상의 이차 도메인의 확률 콘텐츠 q())에 의해 정의되))′Q2x+q1′;0{\displaystyle q({\boldsymbol{x}})={\boldsymbol{)}}'\mathbf{Q_{2}}{\boldsymbol{)}}+{\boldsymbol{q_{1}}}'{\boldsymbol{)}}+q_{0}>. 0}일 경우(어디 Q2{\displaystyle \mathbf{.Q_{2}}}은 ,q 1}})은 ,q 0({0})은 스칼라)는 가우스 판별분석을 이용한 베이지안 분류/결정 이론과 관련된 행렬이며 일반화 카이 제곱 [16]분포에 의해 주어진다f( { f ( { \ { x } > } (서f () { f ( { \ ) > 0 )로 정의되어 있는 임의의 일반 도메인내의 확률 컨텐츠는, 레이 트레이스(Matlab 코드)의 수치 방법을 사용해 계산할 수 있습니다.

모멘트를 높이다

x의 k차 모멘트는 다음과 같습니다.

여기서1 r + r2 + + + rN = k 입니다.

k차 중심 모멘트는 다음과 같습니다.

- k가 홀수일 경우 μ(x - μ) = 0이다1, …, N.

- k가 k = 2µ과 짝수이면,

여기서 합계는 세트{ 의 모든 할당({을 ((순서 없는) 쌍으로 가져옵니다.즉, k번째(= 2µ = 6) 중심 모멘트의 경우, δ = 3 공분산의 곱을 합한다. (기대값 μ는 근소한 값으로 0으로 간주됨):

2 - - (- 1 {{ ( \ -1 )!개의 합계항(위의 경우 15)으로 각각 v(이 경우 3)공분산의 곱이다.4차 모멘트(4개 변수)의 경우 세 개의 항이 있습니다.6차 모멘트의 경우 3 × 5 = 15 항이 있고, 8차 모멘트의 경우 3 × 5 × 7 = 105 항이 있다.

그런 다음 목록[ 1,\2\의 용어를 r, r, r2 등으로 구성된1 목록의 해당 용어로 대체하여 공분산을 결정합니다.이것을 설명하기 위해서, 다음의 4차 중심 모멘트 케이스를 조사합니다.

여기서 i \ _는 X와j X의i 공분산입니다.위의 방법에서는 먼저 K개의 다른 X 변수 [ xx n]\ [X_right를 사용하여 k번째 모멘트의 일반적인 대소문자를 찾은 후 그에 따라 단순화합니다.예를 들어 [ X X }[ _ { { } 의j X = X { \ \ { n }\222 2 2 \ 2 2222222 2 2 2 2222222 2 2 2 2 2 2 2

정규 벡터의 함수

정규 x({style ( Q + + 0 ({q\\ {x}})="의 2차 형식 1은 이고 0 style 은 스칼라)은 일반화 카이 변수입니다.[16]

f { f가 정규 벡터의 일반적인 스칼라값 라면, 그 확률밀도함수, 누적분포함수 및 역 누적분포함수는 광선추적법(Matlab 코드)[16]으로 계산할 수 있다.

우도 함수

평균 및 공분산 행렬이 알려진 경우 관측 x의 로그 우도는 확률 밀도 함수의 로그일 뿐이다.

- ,

z가 복소수 벡터인 비중심복합 케이스의 원형 대칭 버전은 다음과 같습니다.

즉, 켤레 전치(indicateddisplaystyle를 사용하여 일반 전치(indicated를 바꿉니다.복잡한 정규 분포의 원형 대칭 버전은 정규화 상수에 대해 약간 다른 형태를 가지기 때문에 실제와 약간 다릅니다.

다중 선형 [17]회귀 분석에도 유사한 표기법이 사용됩니다.

정규 벡터의 로그 우도는 정규 벡터의 2차 형식이므로 일반화 카이 제곱 [16]변수로 분포됩니다.

미분 엔트로피

다변량 정규 분포의[18] 미분 엔트로피는 다음과 같습니다.

여기서 막대는 행렬 행렬 행렬식을 나타내고 k는 벡터 공간의 차원도를 나타냅니다.

쿨백-라이블러 발산

N1(μ 1,1Σ){\displaystyle{{N\mathcal}}_ᆭ({\boldsymbol{\mu}}_{1},{\boldsymbol{\Sigma}}_{1})}에서 N0으로 그 Kullback–Leibler 발산({\displaystyle{{N\mathcal}}_ᆯ({\boldsymbol{\mu}}_{0}일 경우,{\boldsymbol{\Sigma}}_{0})},non-singular 매트릭스의와 Σ0은Σ1.:[19]

서 kk는 벡터 공간의 치수입니다.

로그 뒤에 오는 두 개의 항 자체가 밀도 함수의 요소이거나 자연적으로 발생하는 식의 기저 e 로그이기 때문에 로그는 반드시 기저 e를 사용해야 합니다.따라서 이 방정식은 nats 단위로 측정된 결과를 나타냅니다.위의 식 전체를 로그2로e 나누면 비트 단위의 편차가 발생합니다.

1 0일 {}}_1} =}}

상호 정보

분포의 상호 정보는 쿨백-라이블러 발산(Kullback-Leibler divergence)의 특수한 경우이며 서 P(\ P는 완전 다변량 이고Q(\ Q는 1차원 한계 분포의 산물이다.이 문서의 Kullback-Leibler 발산 섹션의 에서 δ1(style은 대각선엔트리가이고 (\symbol\symbol\symb)인 대각선행렬입니다.상호 정보의 공식은 다음과 같습니다.

여기서 0 \ { \ bold { { } the 0 \ { \ _ { 0[citation needed]} where construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct construct

이변량의 경우 상호정보에 대한 표현은 다음과 같다.

관절 정규성

정규 분포 및 독립적

X와 Y Y가 정규 분포로 독립되어 있는 이는 "공동 정규 분포"를 의미합니다. 즉, 쌍은 다변량 정규 분포를 가져야 합니다.단, 공동 정규 분포 변수 쌍은 독립적일 필요가 없습니다(관련되지 않은 경우에만 해당). =

정규 분포 랜덤 변수 두 개가 공동으로 이변량 정규 분포일 필요는 없습니다.

2개의 랜덤 X(\ X와 Y Y가 모두 정규 분포를 갖는다고 해서 쌍 의 정규 분포를 갖는 것은 아닙니다.단순한 예로는 X가 기대치가 0이고 분산이 1인 정규 분포를 X> \ X> }이면 Y \ Y - ( > Y= - X 세 개 이상의 랜덤 변수에 대해 유사한 반례가 있습니다.일반적으로 이러한 합계는 혼합물 [citation needed]모형에 해당합니다.

상관관계와 독립성

일반적으로 랜덤 변수는 상관 관계가 없지만 통계적으로 종속될 수 있습니다.그러나 랜덤 벡터에 다변량 정규 분포가 있으면 상관 관계가 없는 두 개 이상의 성분이 독립적입니다.즉, 쌍으로 독립되어 있는 두 개 이상의 성분이 독립적이라는 것을 의미합니다.그러나 위에서 지적한 바와 같이 정규 분포와 상관 관계가 없는 두 개의 랜덤 변수가 독립적이라는 것은 사실이 아닙니다.

조건부 분포

N차원 x가 다음과 같이 분할된 경우

따라서 μ와 δ는 다음과 같이 구분된다.

그러면 x = a에2 대한 x 조건부1 분포는 다변량 정규 분포(x12 x = a) ~ N(μ, δ)이다.

및 공분산 행렬

22- ( { style }{ } { the the inverse of of of of ( \ style )의 일반화 역수입니다.행렬 σ σ ( \ ) here here here22 here here here here here here here here here here here of of here here {\ {\ {\ {\ {\ {\ {\ {\ {\ {\ {\ {\ {\ of {\ {\ {\ {\ {\ {\ {\ {\ {\ of of of of of of즉, 위의 방정식은 전체 공분산 행렬을 반전시키고, 조건화할 변수에 해당하는 행과 열을 삭제한 다음, 조건부 공분산 행렬을 얻기 위해 역반전하는 것과 같습니다.

그것이 미국)는 가변성을 바꾸는 것을 알면서도 새로운 분산은 의 특정 값에 의존하지 않는다 아마도 더욱 놀라운 것은, 평균Σ 12Σ 22− 1(한− μ 2){\displaystyle{\boldsymbol{\Sigma}}_{12}{\boldsymbol{\Sigma}}_{22}^{)}\left(\mathbf{를}-{\boldsymbol{\mu}}_{2}\rig 이동합니다.h ; 이 값을 a의 값을 모르는 상황과 비교합니다.이1 경우 x의 는 , 11)(\{\left {1},{\ {right

이 결과를 증명하기 위해 도출된 흥미로운 사실은 랜덤 2 와 1 - 12 22- ({ { {})이다움푹 패이다

행렬 δ는1222−1 회귀 계수의 행렬로 알려져 있습니다.

이변량 케이스

x가 과 로 분할되어 있는 이변량의 X2({1})의[21] 분포는 다음과 같습니다.

서 는 과 의 상관계수입니다.

이변량 조건부 기대치

일반적인 경우

X가2 주어질 때 X의 조건부1 기대치는 다음과 같습니다.

증명: 위의 조건부 ({ X_의 예상을 취함으로써 결과를 얻을 수 있습니다.

단위 분산이 있는 중심화된 경우

X가2 주어질 때 X의 조건부1 기대치는

그리고 조건부 분산은

따라서 조건부 분산은 x에 의존하지2 않습니다.

X가2 z보다 작거나 클 때 X의 조건부1 기대치는 다음과 같습니다.[22]: 367

여기서 마지막 비율을 역밀스 비율이라고 합니다.

증명: 2개의 결과는 E ( X 2) x ( \ \{ } ( X _ { \ _ {2} = \x 2}=\ x _ {2}} )를 사용하여 얻을 수 있습니다.

- ( 1 X < ) ( 2 X <) \ }( X_}<z)=\ E 및 예측 속성을 사용합니다.

한계 분포

다변량 정규 랜덤 변수의 부분 집합에 대한 한계 분포를 얻으려면 평균 벡터와 공분산 행렬에서 관련 없는 변수(외부화하려는 변수)를 삭제하기만 하면 됩니다.이에 대한 증거는 다변량 정규 분포와 선형 [23]대수의 정의에서 나옵니다.

예

X = [X1, X2, X3]를 평균 벡터 μ = [μ12, μ3, μ] 및 공분산 행렬 δ(다변량 정규 분포에 대한 표준 모수화)를 갖는 다변량 정규 랜덤 변수라고 가정합니다.′ Σ 그리고 X′)[X1, X3]다변수의 비열한 벡터로 보통이다 μ′의 결합 분포)[μ1, μ3]과 공분산 행열)[Σ 11Σ 13Σ 31Σ 33]{\displaystyle{\boldsymbol{\Sigma}}'={\begin{bmatrix}{\boldsymbol{\Sigma}}_{11}&,{\boldsymbol{\Sigma}}_{13}\\{\boldsymbol{\Sigma}}_{31일}.&{\bold

아핀 변환

Y = c + BX가 X~ )의 아핀 변환 \{\{\}}), 여기서 c는 × 의 벡터 기대 가치와 Rmal 유통 댁+Bμ과 차이 BΣBT 즉, Y번 국도 N(댁+Bμ, BΣ BT){\displaystyle \mathbf{Y}\sim{{N\mathcal}}\left(\mathbf{c}+\mathbf{B}{\boldsymbol{\mu}},\mathbf{B}{\boldsymbol{\Sigma}}\mathbf{B}^{\rm{T}}\right)}. 특히 자이의 어떤 부분 집합은 미약한 페닜다는다변량 정규 분포이기도 합니다.이것을 확인하려면 , 다음의 예를 검토해 주세요.서브셋(X1, X2, X4)T을 추출하려면 , 다음과 같이 합니다.

원하는 요소를 직접 추출합니다.

또 다른 결론은 Z = b · X의 분포입니다.여기서 b는 X와 같은 수의 원소를 가진 상수 벡터이고 점은~ N( b {입니다.이 결과는 다음과 같습니다.

δ의 양의 정의성이 도트 곱의 분산이 양의 값이어야 한다는 것을 암시하는 것을 관찰합니다.

2X와 같은 X의 아핀 변환은 X의 두 독립 실현의 합과 같지 않다.

기하학적 해석

비단일 다변량 정규 분포의 등밀도 등고선은 [24]평균에 중심을 둔 타원체(즉, 초구체의 선형 변환)이다.따라서 다변량 정규 분포는 타원 분포 클래스의 한 예입니다.타원체의 주축 방향은 공분산 행렬(\ 의 고유 벡터에 의해 주어진다.주축의 상대 길이 제곱은 해당 고유값에 의해 제공됩니다.

δ = UT = U δ1/2(U1/2)T가 단위 고유 벡터이고 δ가 고유 값의 대각 행렬인 경우, 다음과 같이 됩니다.

또, 축을 반전해도 N(0, δ)에는 영향이 없기 때문에 U를 회전행렬로 선택할 수 있지만, 열을 반전해도 U의 행렬식 부호가 변화한다.분포 N(μ, δ)은 실질적으로 N(0, I)으로 δ 스케일링되고1/2 U로 회전하며 μ로 환산된다.

반대로 μ, 풀랭크 매트릭스 U 및 양의 대각선 엔트리 δi 중 하나를 선택하면 비단수 다변량 정규 분포를 얻을 수 있습니다.δ가i 0이고 U가 제곱인 경우 결과 공분산T 행렬 U δU는 특이합니다.기하학적으로 이것은 모든 등고선 타원체가 무한히 얇고 n차원 공간에서는 부피가 0임을 의미합니다. 이는 적어도 하나의 주축의 길이가 0이기 때문입니다. 이것이 퇴화 사례입니다.

극좌표(반경 및 각도)로 다시 작성된 이변량 정규 랜덤 변수에서 참 평균 주위의 반지름은 호이트 [25]분포를 따릅니다.

1차원에서는μ ±(\pm 에서 정규 분포의 샘플을 찾을 확률은 약 68.27%이지만, 고차원에서는 표준 편차 타원 영역에서 샘플을 찾을 확률은 낮다.[26]

| 치수 | 확률 |

|---|---|

| 1 | 0.6827 |

| 2 | 0.3935 |

| 3 | 0.1987 |

| 4 | 0.0902 |

| 5 | 0.0374 |

| 6 | 0.0144 |

| 7 | 0.0052 |

| 8 | 0.0018 |

| 9 | 0.0006 |

| 10 | 0.0002 |

통계적 추론

모수 추정

다변량 정규 분포의 공분산 행렬에 대한 최대우도 추정기의 도출은 간단합니다.

즉, 다변량 정규 분포의 확률 밀도 함수(pdf)는 다음과 같습니다.

n개의 관측치 표본에서 공분산 행렬의 ML 추정치는 다음과 같습니다.

이것은 단순히 표본 공분산 행렬입니다.이것은 기대치가 다음과 같은 편향된 추정치입니다.

치우치지 않은 표본 공분산은 다음과 같습니다.

- J행렬 형식 {\ I는 × Ktimes K\ 매트릭스), J는K × × 입니다.

다변량 정규 분포의 모수를 추정하기 위한 Fisher 정보 행렬에는 닫힌 형식 식이 있습니다.예를 들어 이 설정을 사용하여 파라미터 추정을 위한 Cramér-Rao 경계를 계산할 수 있습니다.상세한 것에 대하여는, Fisher 의 정보를 참조해 주세요.

베이지안 추론

베이지안 통계에서 평균 벡터 앞의 켤레는 또 다른 다변량 정규 분포이고, 공분산 행렬 앞의 켤레는 역위샤트 W -({이다. n개의 관측치가 이루어졌다고 가정하자.

그리고 우선 활용사가 배정되었다면

어디에

그리고.

그러면...[citation needed]

어디에

다변량 정규성 검정

다변량 정규성 검정은 주어진 데이터 집합에서 다변량 정규 분포와 유사성을 검사합니다.귀무 가설은 데이터 집합이 정규 분포와 비슷하므로 p-값이 충분히 작으면 비정규 데이터를 나타냅니다.다변량 정규성 검정에는 Larry Rafsky와 Jerome [29]Friedman이 만든 Cox-Small[27] 검정과 Smith와 Jain의 Friedman-Rafsky 검정이 포함됩니다[28].

Mardia의 검정은[30] 왜도 및 첨도 측도의 다변량 확장을 기반으로 합니다.k차원 벡터의 샘플 {x1, ..., x}에n 대해 계산한다.

다변량 정규성의 공 가설에 따라 통계적인 것은 A.mw-parser-output .sfrac{white-space:nowrap}.mw-parser-output.sfrac.tion,.mw-parser-output.sfrac .tion{디스플레이:inline-block, vertical-align:-0.5em, font-size:85%;text-align:센터}.mw-parser-output.sfrac .num,.mw-parser-outp로 대략은 카이 제곱 분포를 가질 것이다.다고.sfrac .den{디스플레이:블록, line-height:1em, 마진:00.1em}.mw-parser-output.sfrac .den{border-top:1px 고체}.mw-parser-output 자유의 .sr-onlyᆮ1(k+1)(k+2)도, B가 대략 표준 정상 N(0,1).

마르디아의 첨도 통계량은 치우쳐져 있으며 제한된 정규 분포로 매우 느리게 수렴됩니다.중간 크기 표본< {n < 의 경우 첨도 통계량의 점근 분포 모수가 수정되고[31] 소규모 표본 검사(< \n <) 경험적 임계값이 사용됩니다.렌처는[32] k = 2, 3, 4에 대해 두 통계량에 대한 임계값 표를 제공한다.

마르디아의 테스트는 아핀 불변성이지만 일관성은 없다.예를 들어, 다변량 왜도 검정이 대칭 비정규 [33]검정과 일치하지 않습니다.

BHEP 테스트는[34] 정규 분포의 경험적 특성 함수와 이론적 특성 함수 사이의 차이에 대한 규범을 계산합니다.노름의 계산은 가우스 가중 β ( ) ( 2 )- k / e - / ( { \ t } ( \ { t } ) ( 2 \ \ ^ { ^ 2 ) / / { 2 ^ 2 에 대하여 제곱적분함수의 L () 공간에서2 행해진다.테스트 통계는

이 검정 통계량의 한계 분포는 카이 제곱 랜덤 [34]변수의 가중치 합이지만, 실제로는 몬테카를로 [citation needed]시뮬레이션을 사용하여 표본 분위수를 계산하는 것이 더 편리합니다.

이러한 테스트 절차 및 기타 테스트 절차에 대한 자세한 조사를 [35]이용할 수 있습니다.

다변량 정규 등급으로 분류

가우스 판별 분석

관측치(벡터)가 알려진 평균과 공분산을 가진 여러 다변량 정규 분포 중 하나에서 나온다고 가정합니다.그런 다음 주어진 관측치를 발생 확률이 가장 높은 분포에 할당할 수 있습니다.이 분류 절차를 가우스 판별 분석이라고 합니다.분류 성능, 즉 다른 분류 결과의 확률과 전체적인 분류 오류는 수치적 광선 추적 방법(Matlab 코드)으로 계산할 수 있다.

계산 방법

분포에서 값 그리기

N차원 다변량 정규분포에서 평균 벡터 μ 및 공분산 행렬 δ를 사용하여 랜덤 벡터 x를 추출(샘플링)하는 데 널리 사용되는 방법은 [36]다음과 같이 작동합니다.

- AT = Ω인 실행렬 A를 구한다.δ가 양의 확정일 경우, 일반적으로 콜레스키 분해가 사용되며, 이 분해의 확장된 형태는 항상 사용할 수 있다(공분산 행렬이 양의 반정의 것일 수 있으므로). 두 경우 모두 적절한 행렬 A를 얻을 수 있다.대안으로 δ의 스펙트럼 분해 δ = U−1 δU에서 얻은 매트릭스 A = U½ δ를 사용한다.전자의 접근방식은 계산적으로 더 간단하지만 행렬 A는 랜덤 벡터 요소의 다른 순서에 따라 변경되며, 후자의 접근방식은 단순한 재순서로 관련된 행렬을 제공한다.이론적으로 두 접근법 모두 적절한 행렬 A를 결정하는 데 동일한 좋은 방법을 제공하지만, 계산 시간에는 차이가 있다.

- z = (z1, …, zN)T 성분이 N개의 독립적인 표준 정규 변수인 벡터라고 가정합니다(예를 들어, 박스-뮬러 변환을 사용하여 생성할 수 있습니다).

- x를 μ + Az로 합니다.이것은 아핀 변환 속성으로 인해 원하는 분포를 가집니다.

「 」를 참조해 주세요.

- 카이 분포, 다변량 정규 분포 벡터(비상관 및 제로 중심)의 2-노름(유클리드 노름 또는 벡터 길이)의 pdf입니다.

- 이변량 정규 분포의 적용인 복소 정규 분포

- 코풀라, 가우스 또는 일반 코풀라 모델의 정의를 위한 것입니다.

- 다변량 t-분포, 이것은 또 다른 널리 사용되는 구형 대칭 다변량 분포입니다.

- 지수(특성 함수에서 지수)가 0과 2 사이인 경우 다변량 정규 분포의 다변량 안정 분포 확장입니다.

- 마할라노비스 거리

- 위샤트 배포

- 행렬 정규 분포

레퍼런스

- ^ a b c Lapidoth, Amos (2009). A Foundation in Digital Communication. Cambridge University Press. ISBN 978-0-521-19395-5.

- ^ Gut, Allan (2009). An Intermediate Course in Probability. Springer. ISBN 978-1-441-90161-3.

- ^ Kac, M. (1939). "On a characterization of the normal distribution". American Journal of Mathematics. 61 (3): 726–728. doi:10.2307/2371328. JSTOR 2371328.

- ^ Sinz, Fabian; Gerwinn, Sebastian; Bethge, Matthias (2009). "Characterization of the p-generalized normal distribution". Journal of Multivariate Analysis. 100 (5): 817–820. doi:10.1016/j.jmva.2008.07.006.

- ^ 사이먼 J.D.프린스(2012년 6월).컴퓨터 비전: 모델, 학습 및 추론.케임브리지 대학 출판부. 3.7:"다변량 정규 분포"

- ^ Hamedani, G. G.; Tata, M. N. (1975). "On the determination of the bivariate normal distribution from distributions of linear combinations of the variables". The American Mathematical Monthly. 82 (9): 913–915. doi:10.2307/2318494. JSTOR 2318494.

- ^ Wyatt, John (November 26, 2008). "Linear least mean-squared error estimation" (PDF). Lecture notes course on applied probability. Archived from the original (PDF) on October 10, 2015. Retrieved 23 January 2012.

- ^ "linear algebra - Mapping beetween affine coordinate function". Mathematics Stack Exchange. Retrieved 2022-06-24.

- ^ Rao, C. R. (1973). Linear Statistical Inference and Its Applications. New York: Wiley. pp. 527–528. ISBN 0-471-70823-2.

- ^ a b Botev, Z. I. (2016). "The normal law under linear restrictions: simulation and estimation via minimax tilting". Journal of the Royal Statistical Society, Series B. 79: 125–148. arXiv:1603.04166. Bibcode:2016arXiv160304166B. doi:10.1111/rssb.12162. S2CID 88515228.

- ^ Genz, Alan (2009). Computation of Multivariate Normal and t Probabilities. Springer. ISBN 978-3-642-01689-9.

- ^ a b Bensimhoon Michael, N차원 누적 함수 및 가우시안 및 정규 밀도에 관한 기타 유용한 사실(2006)

- ^ Siotani, Minoru (1964). "Tolerance regions for a multivariate normal population" (PDF). Annals of the Institute of Statistical Mathematics. 16 (1): 135–153. doi:10.1007/BF02868568. S2CID 123269490.

- ^ a b Botev, Z. I.; Mandjes, M.; Ridder, A. (6–9 December 2015). "Tail distribution of the maximum of correlated Gaussian random variables". 2015 Winter Simulation Conference (WSC). Huntington Beach, Calif., USA: IEEE. pp. 633–642. doi:10.1109/WSC.2015.7408202. ISBN 978-1-4673-9743-8.

- ^ Adler, R. J.; Blanchet, J.; Liu, J. (7–10 Dec 2008). "Efficient simulation for tail probabilities of Gaussian random fields". 2008 Winter Simulation Conference (WSC). Miami, Fla., USA: IEEE. pp. 328–336. doi:10.1109/WSC.2008.4736085. ISBN 978-1-4244-2707-9.

{{cite conference}}: CS1 유지보수: 날짜 및 연도(링크) - ^ a b c d e f g h i Das, Abhranil (2020). "A method to integrate and classify normal distributions". arXiv:2012.14331 [stat.ML].

- ^ Tong, T. (2010) 다중 선형 회귀: MLE와 그 분포 결과, 2013-06-16 WebCite, 강의 노트 아카이브

- ^ Gokhale, DV; Ahmed, NA; Res, BC; Piscataway, NJ (May 1989). "Entropy Expressions and Their Estimators for Multivariate Distributions". IEEE Transactions on Information Theory. 35 (3): 688–692. doi:10.1109/18.30996.

- ^ Duchi, J. "Derivations for Linear Algebra and Optimization" (PDF): 13.

{{cite journal}}:Cite 저널 요구 사항journal=(도움말) - ^ Eaton, Morris L. (1983). Multivariate Statistics: a Vector Space Approach. John Wiley and Sons. pp. 116–117. ISBN 978-0-471-02776-8.

- ^ Jensen, J (2000). Statistics for Petroleum Engineers and Geoscientists. Amsterdam: Elsevier. p. 207.

- ^ Maddala, G. S. (1983). Limited Dependent and Qualitative Variables in Econometrics. Cambridge University Press. ISBN 0-521-33825-5.

- ^ 한계 분포의 대수적 계산은 http://fourier.eng.hmc.edu/e161/lectures/gaussianprocess/node7.html Archived 2010-01-17 at the Wayback Machine에 나와 있습니다.훨씬 더 짧은 증명은 https://math.stackexchange.com/a/3832137에 기재되어 있습니다.

- ^ Nikolaus Hansen (2016). "The CMA Evolution Strategy: A Tutorial" (PDF). arXiv:1604.00772. Bibcode:2016arXiv160400772H. Archived from the original (PDF) on 2010-03-31. Retrieved 2012-01-07.

- ^ Daniel Wollschlaeger. "The Hoyt Distribution (Documentation for R package 'shotGroups' version 0.6.2)".[영구 데드링크]

- ^ Wang, Bin; Shi, Wenzhong; Miao, Zelang (2015-03-13). Rocchini, Duccio (ed.). "Confidence Analysis of Standard Deviational Ellipse and Its Extension into Higher Dimensional Euclidean Space". PLOS ONE. 10 (3): e0118537. Bibcode:2015PLoSO..1018537W. doi:10.1371/journal.pone.0118537. ISSN 1932-6203. PMC 4358977. PMID 25769048.

- ^ Cox, D. R.; Small, N. J. H. (1978). "Testing multivariate normality". Biometrika. 65 (2): 263. doi:10.1093/biomet/65.2.263.

- ^ Smith, S. P.; Jain, A. K. (1988). "A test to determine the multivariate normality of a data set". IEEE Transactions on Pattern Analysis and Machine Intelligence. 10 (5): 757. doi:10.1109/34.6789.

- ^ Friedman, J. H.; Rafsky, L. C. (1979). "Multivariate Generalizations of the Wald–Wolfowitz and Smirnov Two-Sample Tests". The Annals of Statistics. 7 (4): 697. doi:10.1214/aos/1176344722.

- ^ Mardia, K. V. (1970). "Measures of multivariate skewness and kurtosis with applications". Biometrika. 57 (3): 519–530. doi:10.1093/biomet/57.3.519.

- ^ 렌처(1995), 112~113쪽.

- ^ 렌처(1995), 493~495쪽.

- ^ Baringhaus, L.; Henze, N. (1991). "Limit distributions for measures of multivariate skewness and kurtosis based on projections". Journal of Multivariate Analysis. 38: 51–69. doi:10.1016/0047-259X(91)90031-V.

- ^ a b Baringhaus, L.; Henze, N. (1988). "A consistent test for multivariate normality based on the empirical characteristic function". Metrika. 35 (1): 339–348. doi:10.1007/BF02613322. S2CID 122362448.

- ^ Henze, Norbert (2002). "Invariant tests for multivariate normality: a critical review". Statistical Papers. 43 (4): 467–506. doi:10.1007/s00362-002-0119-6. S2CID 122934510.

- ^ Gentle, J. E. (2009). Computational Statistics. Statistics and Computing. New York: Springer. pp. 315–316. doi:10.1007/978-0-387-98144-4. ISBN 978-0-387-98143-7.

문학.

- Rencher, A.C. (1995). Methods of Multivariate Analysis. New York: Wiley.

- Tong, Y. L. (1990). The multivariate normal distribution. Springer Series in Statistics. New York: Springer-Verlag. doi:10.1007/978-1-4613-9655-0. ISBN 978-1-4613-9657-4. S2CID 120348131.

![{\displaystyle {\boldsymbol {\Sigma }}=\left[{\begin{smallmatrix}1&3/5\\3/5&2\end{smallmatrix}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ee3a76f734b37fcce91f30617152fe104b2782bc)

다변량 정규 분포는 다음과 같은 표기법으로 쓸 수 있다.

다변량 정규 분포는 다음과 같은 표기법으로 쓸 수 있다.

![{\displaystyle {\boldsymbol {\mu }}=\operatorname {E} [\mathbf {X} ]=(\operatorname {E} [X_{1}],\operatorname {E} [X_{2}],\ldots ,\operatorname {E} [X_{k}])^{\textbf {T}},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e69e434645f47377bc8766624255c8026adf7964)

![{\displaystyle \Sigma _{i,j}=\operatorname {E} [(X_{i}-\mu _{i})(X_{j}-\mu _{j})]=\operatorname {Cov} [X_{i},X_{j}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c970083f8469366521881996464f23d376b7c40b)

존재하는 경우 중심 정규 랜덤 벡터라고 합니다

존재하는 경우 중심 정규 랜덤 벡터라고 합니다

{\

{\

일반적으로 독립적이지 않습니다

일반적으로 독립적이지 않습니다

정규

정규

실제 k차원 열 벡터이고

실제 k차원 열 벡터이고  det

det

![{\displaystyle {\text{[XY]′}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/24925a0dd360004248b2a1de70e2b0bcf3fcf687)

![{\displaystyle f(x,y)={\frac {1}{2\pi \sigma _{X}\sigma _{Y}{\sqrt {1-\rho ^{2}}}}}\exp \left(-{\frac {1}{2(1-\rho ^{2})}}\left[\left({\frac {x-\mu _{X}}{\sigma _{X}}}\right)^{2}-2\rho \left({\frac {x-\mu _{X}}{\sigma _{X}}}\right)\left({\frac {y-\mu _{Y}}{\sigma _{Y}}}\right)+\left({\frac {y-\mu _{Y}}{\sigma _{Y}}}\right)^{2}\right]\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c616921276f29c0c0cd5383fd81045939f8f6e82)

주의를 제한하여 이 부분 집합의 공분산 행렬이 양의 행렬이 되도록 하는 것이 더 간단할 수 있다.다른 좌표는 선택된 좌표의

주의를 제한하여 이 부분 집합의 공분산 행렬이 양의 행렬이 되도록 하는 것이 더 간단할 수 있다.다른 좌표는 선택된 좌표의

X

X

표준편차의

표준편차의

k

k 대한

대한

정의되어 있는 임의의 일반 도메인내의 확률 컨텐츠는, 레이

정의되어 있는 임의의 일반 도메인내의 확률 컨텐츠는, 레이 ![{\displaystyle \mu _{1,\ldots ,N}(\mathbf {x} )\ {\stackrel {\mathrm {def} }{=}}\ \mu _{r_{1},\ldots ,r_{N}}(\mathbf {x} )\ {\stackrel {\mathrm {def} }{=}}\operatorname {E} \left[\prod _{j=1}^{N}X_{j}^{r_{j}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/68bafb23658afe2f4246d5f27781aac7eeacbaa7)

((순서 없는) 쌍으로 가져옵니다.즉, k번째

((순서 없는) 쌍으로 가져옵니다.즉, k번째![{\displaystyle {\begin{aligned}&\operatorname {E} [X_{1}X_{2}X_{3}X_{4}X_{5}X_{6}]\\[8pt]={}&\operatorname {E} [X_{1}X_{2}]\operatorname {E} [X_{3}X_{4}]\operatorname {E} [X_{5}X_{6}]+\operatorname {E} [X_{1}X_{2}]\operatorname {E} [X_{3}X_{5}]\operatorname {E} [X_{4}X_{6}]+\operatorname {E} [X_{1}X_{2}]\operatorname {E} [X_{3}X_{6}]\operatorname {E} [X_{4}X_{5}]\\[4pt]&{}+\operatorname {E} [X_{1}X_{3}]\operatorname {E} [X_{2}X_{4}]\operatorname {E} [X_{5}X_{6}]+\operatorname {E} [X_{1}X_{3}]\operatorname {E} [X_{2}X_{5}]\operatorname {E} [X_{4}X_{6}]+\operatorname {E} [X_{1}X_{3}]\operatorname {E} [X_{2}X_{6}]\operatorname {E} [X_{4}X_{5}]\\[4pt]&{}+\operatorname {E} [X_{1}X_{4}]\operatorname {E} [X_{2}X_{3}]\operatorname {E} [X_{5}X_{6}]+\operatorname {E} [X_{1}X_{4}]\operatorname {E} [X_{2}X_{5}]\operatorname {E} [X_{3}X_{6}]+\operatorname {E} [X_{1}X_{4}]\operatorname {E} [X_{2}X_{6}]\operatorname {E} [X_{3}X_{5}]\\[4pt]&{}+\operatorname {E} [X_{1}X_{5}]\operatorname {E} [X_{2}X_{3}]\operatorname {E} [X_{4}X_{6}]+\operatorname {E} [X_{1}X_{5}]\operatorname {E} [X_{2}X_{4}]\operatorname {E} [X_{3}X_{6}]+\operatorname {E} [X_{1}X_{5}]\operatorname {E} [X_{2}X_{6}]\operatorname {E} [X_{3}X_{4}]\\[4pt]&{}+\operatorname {E} [X_{1}X_{6}]\operatorname {E} [X_{2}X_{3}]\operatorname {E} [X_{4}X_{5}]+\operatorname {E} [X_{1}X_{6}]\operatorname {E} [X_{2}X_{4}]\operatorname {E} [X_{3}X_{5}]+\operatorname {E} [X_{1}X_{6}]\operatorname {E} [X_{2}X_{5}]\operatorname {E} [X_{3}X_{4}].\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0517839a9528128fa6d69cedfe4f5003a34716f4)

![{\displaystyle [1,\ldots ,2\lambda ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a605bf32a38577fe9df1bc5715a4a3cac5869832) 용어를 r, r, r2 등으로 구성된1 목록의 해당 용어로 대체하여 공분산을 결정합니다.이것을 설명하기 위해서, 다음의 4차 중심 모멘트 케이스를 조사합니다.

용어를 r, r, r2 등으로 구성된1 목록의 해당 용어로 대체하여 공분산을 결정합니다.이것을 설명하기 위해서, 다음의 4차 중심 모멘트 케이스를 조사합니다.![{\displaystyle {\begin{aligned}\operatorname {E} \left[X_{i}^{4}\right]&=3\sigma _{ii}^{2}\\[4pt]\operatorname {E} \left[X_{i}^{3}X_{j}\right]&=3\sigma _{ii}\sigma _{ij}\\[4pt]\operatorname {E} \left[X_{i}^{2}X_{j}^{2}\right]&=\sigma _{ii}\sigma _{jj}+2\sigma _{ij}^{2}\\[4pt]\operatorname {E} \left[X_{i}^{2}X_{j}X_{k}\right]&=\sigma _{ii}\sigma _{jk}+2\sigma _{ij}\sigma _{ik}\\[4pt]\operatorname {E} \left[X_{i}X_{j}X_{k}X_{n}\right]&=\sigma _{ij}\sigma _{kn}+\sigma _{ik}\sigma _{jn}+\sigma _{in}\sigma _{jk}.\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4e08f5bc180e3f1f4379c1026100e833ea85de97)

X와j X의i 공분산입니다.위의 방법에서는 먼저 K개의 다른 X 변수

X와j X의i 공분산입니다.위의 방법에서는 먼저 K개의 다른 X 변수![{\displaystyle E\left[X_{i}X_{j}X_{k}X_{n}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0b4bbbf2becaf15b246898e928a37e7d0ab6f93a)

![{\displaystyle \operatorname {E} [X_{i}^{2}X_{k}X_{n}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f7bc1920d0e524aa567ca471bdb54dcf7ef7e673)

단일

단일

![{\displaystyle \ln L({\boldsymbol {x}})=-{\frac {1}{2}}\left[\ln(|{\boldsymbol {\Sigma }}|\,)+({\boldsymbol {x}}-{\boldsymbol {\mu }})'{\boldsymbol {\Sigma }}^{-1}({\boldsymbol {x}}-{\boldsymbol {\mu }})+k\ln(2\pi )\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4ad05643016bbf6ac76a826320bea00704b50982)

복소수 벡터인 비중심복합 케이스의 원형 대칭 버전은 다음과 같습니다.

복소수 벡터인 비중심복합 케이스의 원형 대칭 버전은 다음과 같습니다.

완전 다변량

완전 다변량  1차원 한계 분포의 산물이다.

1차원 한계 분포의 산물이다.

다변량 정규 분포를 가져야 합니다.단, 공동 정규 분포 변수 쌍은 독립적일 필요가 없습니다(관련되지 않은 경우에만 해당).

다변량 정규 분포를 가져야 합니다.단, 공동 정규 분포 변수 쌍은 독립적일 필요가 없습니다(관련되지 않은 경우에만 해당).

Y

Y

일반화 역수입니다.행렬

일반화 역수입니다.행렬

예상을 취함으로써 결과를 얻을 수 있습니다.

예상을 취함으로써 결과를 얻을 수 있습니다.

c는

c는

정규 분포의 샘플을 찾을 확률은 약 68.27%이지만, 고차원에서는 표준 편차 타원 영역에서 샘플을 찾을 확률은 낮다.

정규 분포의 샘플을 찾을 확률은 약 68.27%이지만, 고차원에서는 표준 편차 타원 영역에서 샘플을 찾을 확률은 낮다.

![E[\widehat{\boldsymbol\Sigma}] = \frac{n-1}{n} \boldsymbol\Sigma.](https://wikimedia.org/api/rest_v1/media/math/render/svg/bacdf39e0509492e90dbb2fb2fdcaac78ca196db)

![{\displaystyle {\widehat {\boldsymbol {\Sigma }}}={\frac {1}{n-1}}\sum _{i=1}^{n}(\mathbf {x} _{i}-{\overline {\mathbf {x} }})(\mathbf {x} _{i}-{\overline {\mathbf {x} }})^{\rm {T}}={\frac {1}{n-1}}\left[X'\left(I-{\frac {1}{n}}\cdot J\right)X\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b483843b0f64ecbfea751011ef0ab8e61c7f0dcc)

![\begin{align}

& \widehat{\boldsymbol\Sigma} = {1 \over n} \sum_{j=1}^n \left(\mathbf{x}_j - \bar{\mathbf{x}}\right)\left(\mathbf{x}_j - \bar{\mathbf{x}}\right)^T \\

& A = {1 \over 6n} \sum_{i=1}^n \sum_{j=1}^n \left[ (\mathbf{x}_i - \bar{\mathbf{x}})^T\;\widehat{\boldsymbol\Sigma}^{-1} (\mathbf{x}_j - \bar{\mathbf{x}}) \right]^3 \\

& B = \sqrt{\frac{n}{8k(k+2)}}\left\{{1 \over n} \sum_{i=1}^n \left[ (\mathbf{x}_i - \bar{\mathbf{x}})^T\;\widehat{\boldsymbol\Sigma}^{-1} (\mathbf{x}_i - \bar{\mathbf{x}}) \right]^2 - k(k+2) \right\}

\end{align}](https://wikimedia.org/api/rest_v1/media/math/render/svg/379e5ee62d84b83c7e77088847f4855f6e6b1fed)

샘플을

샘플을